機器學習舉一反三(2/2)

機器學習舉一反三(2/2)

撰文/Alison Gopnik|譯者/鍾樹人

轉載自《科學人》2017年9月第187期

科學家長期研究人類的學習方式,以教導電腦如何學習。現在運用貝氏推論的人工智慧,僅需數個範例就可辨識圖形,表現堪比人類。

(續前文)

由上而下

另一種機器學習的方法,在近幾年改變了AI的發展,運作方式剛好相反:由上而下。我們假設人類可以從實際資料裡獲得抽象知識,因為人類已經知道很多事,更是因為大腦已經了解基本的抽象概念。就像科學家一樣,我們可以藉由這些概念建構關於這個世界的假設,如果假設正確,就能預測資料(事件)的樣貌;相較之下,採行由下而上方法的AI會設法從原始資料中擷取出模式,做法南轅北轍。

要說明這個概念,可討論上述泛濫成災的詐騙信,這回談一件跟我有關的真實案例。我先前收到某期刊編輯寄來的電子郵件,那份期刊名稱奇怪。編輯明確提到我的一篇論文,並提議我寫篇論文發表在這本期刊。這封電子郵件中沒有提到奈及利亞、威而鋼和百萬美元獎金,沒有詐騙信共同的特徵。但我依據已經知道的資訊,並且抽象思考詐騙信的產生方式,可以判定這封電子郵件很可疑。

首先,我知道詐騙信發送者騙取他人錢財的手法是基於人類的貪婪;學術圈人士對發表論文的渴望,可能跟一般人對百萬美元獎金或性能力的渴求一樣強烈。其次,我知道「開放取用」期刊已經開始向作者收費來分擔成本,而非向訂閱者收費。另外,我的工作跟期刊名稱完全不相干。綜合以上因素,我提出合理假設:這類電子郵件想讓學術圈人士誤以為只要付費給「假」期刊就能「發表」論文。我從單一例子就得出這項結論,而且還能進一步測試自己的假設:透過搜尋引擎查詢這位編輯是否真有其人。

資訊科學家會說我的推論過程是「生成模型」(generative model),生成模型能描繪抽象概念,例如貪婪與欺騙。同樣的模型也可以描述提出假設的過程,這個推論過程得出這封郵件可能是詐騙信的結論。運用這個模型,我能假想這種類型的詐騙信如何運作,也能揣測其他類型,即使是我從未看過或聽過。當我收到這個期刊寄來的電子郵件,便能反向運用這個模型,一步步追查這封郵件的真偽。

1950~60年代第一波AI和認知科學的發展中,生成模型至關重要,但也有局限。首先,原則上我們可以用各種不同的假設來解釋大多數證據模式;就我的例子而言,即使那封郵件看似詐騙信,但也可能不是。於是,生成模型必須納入機率概念,而機率是這些方法近來最重大的進展之一。其次,我們通常不知道那些構成生成模型的基本概念出自何處。笛卡兒與喬姆斯基(Noam Chomsky)這類學者指出,你天生就擁有這些概念,但你一誕生在世上時就知道他人如何憑藉貪婪和謊言來詐騙?

貝氏模型是近來由上而下方法的絕佳範例,試圖處理這兩個問題。貝氏模型是以18世紀統計學家兼哲學家貝茲(Thomas Bayes)為名,利用一種稱為貝氏推論(Bayesian inference)的方法,結合生成模型與機率論。機率生成模型可以告訴你,如果某個假設為真,你看到特定模式資料的機率有多高。如果某封電子郵件是場騙局,可能就是基於收件者的貪婪。不過,基於貪婪的電子郵件不一定是詐騙信。貝氏模型結合你提出假設所依據的知識以及你手上的資料,讓你精準計算某封電子郵件是詐騙信的機率。

比起由下而上的方式,這種由上而下的方式更符合我們對孩童學習方式的認知,這就是為什麼過去15年我和同事一直採用貝氏模型來研究他們的學習方式。我們與其他實驗室都使用這些技術來了解孩童學習的因果關係,預測他們如何與何時會萌生出關於這個世界的新想法,以及何時會改變既有的想法。

貝氏方法也是教導機器像人一樣學習的絕妙方式。2015年,美國麻省理工學院(MIT)的特南鮑姆(Joshua B. Tenenbaum)和紐約大學的雷克(Breden M. Lake)等人在《科學》期刊發表研究,設計了一套可以辨識手寫字的AI系統;人類可以輕易辦到這件事,對機器來說卻非常棘手。

試想你的辨識能力,即使你從未看過日文捲軸上的字,大概也能分辨不同捲軸上的文字是否相同。搞不好你還可以寫出日文字,甚至設計出假的單字,並且知道日文與韓文或俄文大相逕庭。這正是特南鮑姆的團隊要讓AI做到的事。

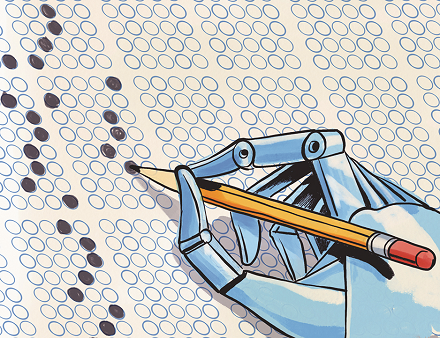

如果採用由下而上的方法,電腦要接收成千上萬的範例,從這些範例中找到模式,藉由模式辨識新的字。相較之下,貝氏方法則給電腦一個如何寫字的通用模式,舉例來說,一畫可能是往左或往右。電腦在處理完一個字後,會接續下個字。

當電腦看到一個字,會推論這個字的筆畫順序,接著產生一套類似的筆畫,這就像我推論那封疑似期刊詐騙的電子郵件所採取的一連串步驟。特南鮑姆的方式不是推論那封電子郵件是否可能來自詐騙管道,而是猜測特定的筆畫順序是否可能寫出相符的字。在同樣的資料上,採用由上而下方式的電腦會表現得比深度學習更好,也更接近人類表現。

巧妙結合兩種方法

這兩種主要的機器學習方法:由下而上與由上而下,優缺點恰能彼此互補。利用由下而上的方法,電腦一開始不需要對貓有任何了解,但它需要大量的資料。

採用貝氏模型的電腦可以從少數範例中學習,而且能更廣泛推論。不過採行這種由上而下的方法,事先需要做很多功課,才能提出一套正確的假設。兩種系統的設計者可能會遇到類似的障礙:只能處理範圍相對較小、定義明確的問題,例如辨識手寫字、貓或玩雅達利的電玩遊戲。

孩童面臨同樣的限制,卻遊刃有餘。發展心理學家已經發現,不知為何,孩童會結合各種方法的最佳特色,並發展出新的方法。奧吉可以僅靠一兩個例子就學到知識,由上而下的系統也是如此。但不知為何,奧吉也會從資料本身擷取新的概念,就像由下而上的系統一樣,即使那些概念一開始並不存在。

事實上,奧吉不只能辦到這些事。他很快就認得貓與區別字母,但他也能做出有創意又令人驚喜的新推論,這些推論已經超出他的經驗或背景知識。他最近就解釋,如果大人想要再次變成小孩,應該不要吃任何有益健康的蔬菜,因為蔬菜會讓小孩長成大人。這種創意推理是從哪裡冒出來的,我們幾乎毫無頭緒。

當我們聽到有人主張AI是一種「存在威脅」時,我們應該想起人類大腦依然神秘的力量。AI和機器學習聽起來很嚇人,就某些方面來說確實如此。軍方正在研究使用這些系統來控制武器的方法;人類的愚蠢相較AI可能造成更多破壞,我們必須比以前更有智慧,才能適當管理這些新科技。

摩爾定律是一大影響力:即使資訊科技的進步是基於資料量和電腦處理能力的大幅增加,而不是我們對心智的了解有觀念上的突破,但這些進展日後依然會有重大成果。儘管如此,我們也不應該認為新的科技泥人會有如脫韁野馬在世上橫衝直撞。(完)

(本文由教育部補助「AI報報─AI科普推廣計畫」取得網路轉載授權)

前一篇文章

前一篇文章 下一篇文章

下一篇文章 智能道路的未來

智能道路的未來  偏見如何形成?由人類到AI

偏見如何形成?由人類到AI  AI挑戰皮膚癌診斷

AI挑戰皮膚癌診斷  大數據揭開自閉心門(1/2)

大數據揭開自閉心門(1/2)  好萊塢夢幻明星隊

好萊塢夢幻明星隊  宜家機器人

宜家機器人  AI需要新版涂林測試

AI需要新版涂林測試  由2D到3D:全像式圖片生成網路HoloGAN

由2D到3D:全像式圖片生成網路HoloGAN