【漫畫說科學】AI偏見

AI偏見

國立臺灣大學科學教育發展中心製作

AI人工智慧給社會大眾的印象多半是理性而客觀的,會對AI有這樣的觀感,主要的原因,乃是因為人工智慧在做決斷時,所倚仗的「數據」。

大數據來自於現實世界,但若是數據很大,卻不夠公正呢?

現今的AI多採用監督式學習,藉由工程師提供的訓練資料來推斷規律,進而套用在未知的資料上,可以讓AI達到自主學習的目標。但是當資料庫不夠齊全,或者有所偏頗的時候,可能會培養出具有偏見的AI。

然而,就算數據資料多元,也難以防範人類文化裡無形的歧視,例如:「醫生」容易與「男性」連結、「護士」容易與「女性」連結,AI所表現出來的偏見,其實是重現整體社會的問題,我們不得不審慎思考背後所代表的意義。

訓練AI的時候,大數據未必是真理與正義的一方,因此可能還需要搭配一些「平衡報導」,以培養觀點公正的AI。

參考資料:

前一篇文章

前一篇文章 下一篇文章

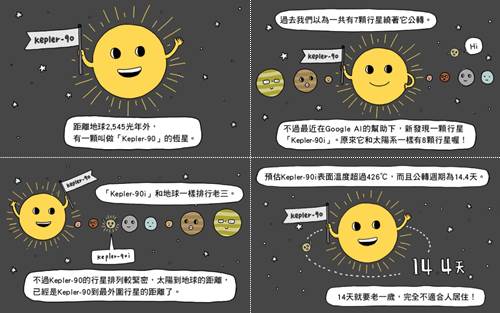

下一篇文章 【漫畫說科學】Kepler-90i

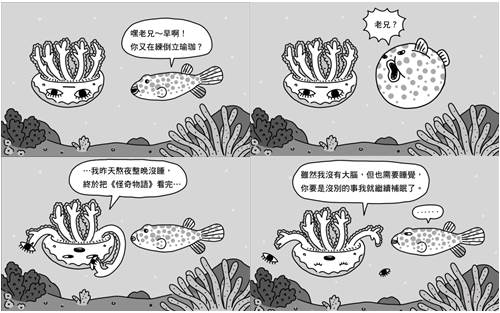

【漫畫說科學】Kepler-90i  【漫畫說科學】水母愛睡覺

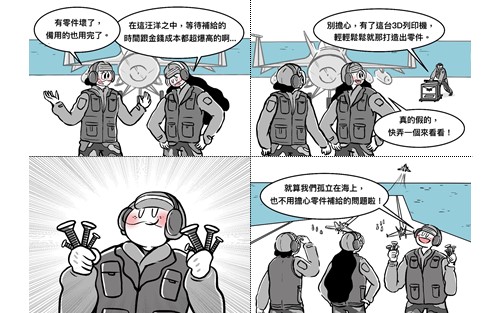

【漫畫說科學】水母愛睡覺  【漫畫說科學】3D列印的軍事用途

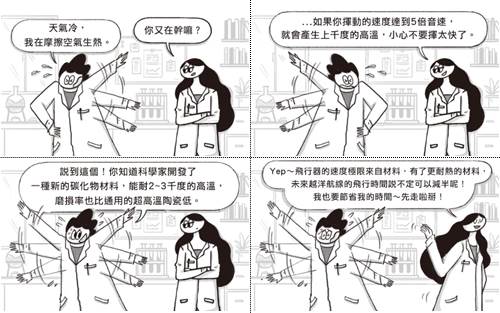

【漫畫說科學】3D列印的軍事用途  【漫畫說科學】耐高溫材料

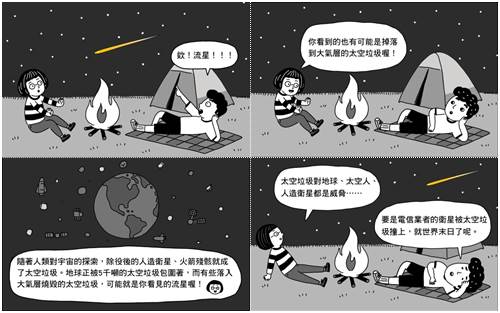

【漫畫說科學】耐高溫材料  【漫畫說科學】太空垃圾

【漫畫說科學】太空垃圾 ![[展覽] Eye Contact 科學中的視覺傳達](https://highscope.ch.ntu.edu.tw/wordpress/wp-content/uploads/2016/09/12358744.png) [展覽] Eye Contact 科學中的視覺傳達

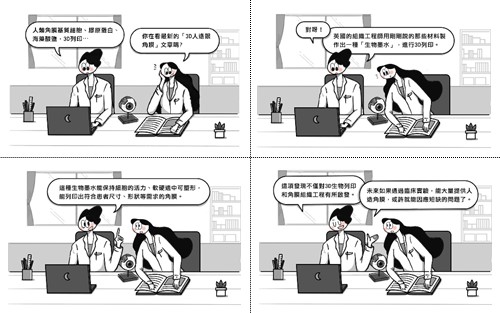

[展覽] Eye Contact 科學中的視覺傳達  【漫畫說科學】3D列印人造角膜

【漫畫說科學】3D列印人造角膜  【漫畫說科學】竹節蟲與牠的卵

【漫畫說科學】竹節蟲與牠的卵